-

Жанры

-

Художественная литература

- Приключения 75083

- Фантастика 100897

- Фэнтези 73474

- Детектив 59379

- Ужасы 48028

- Роман 70045

- Классическая литература 60314

- Историческая проза 8094

- Современная проза 141702

- Детская литература

- Культура и искусство

- Научная литература

- История

- Бизнес

- Прикладная литература

- Документальная литература

- Образование

- Дом и семья

- Физическая культура

- Здоровье

- Литература на иностранных языках

-

Художественная литература

- Книги

- Рецензии

- Сообщество

- Блоги

- Цитаты

- Тесты

- Подборки

- Премии

- Конкурсы

- Другое

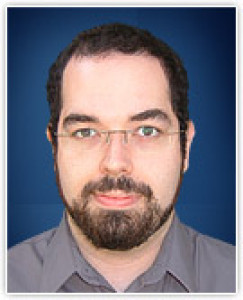

Элиезер Юдковский

Краткая биография автора

Элие́зер Шло́мо Юдко́вский (англ. Eliezer S. Yudkowsky, 11 сентября 1979) — американский специалист по искусственному интеллекту, исследующий проблемы технологической сингулярности и выступающий за создание Дружественного ИИ.Юдковский — сооснователь и научный сотрудник Института Сингулярности по созданию Искусственного Интеллекта Singularity Institute for Artificial Intelligence (SIAI). Он — автор книги «Создание дружественного ИИ» («Creating Friendly AI» 2001), статей «Уровни организации универ...

Элие́зер Шло́мо Юдко́вский (англ. Eliezer S. Yudkowsky, 11 сентября 1979) — американский специалист по искусственному интеллекту, исследующий проблемы технологической сингулярности и выступающий за создание Дружественного ИИ.Юдковский — сооснователь и научный сотрудник Института Сингулярности по созданию Искусственного Интеллекта Singularity Institute for Artificial Intelligence (SIAI). Он — автор книги «Создание дружественного ИИ» («Creating Friendly AI» 2001), статей «Уровни организации универсального интеллекта» («Levels of Organization in General Intelligence», 2002), «Когерентная экстраполированная воля» («Coherent Extrapolated Volition», 2004) и «Вневременная теория принятия решений» («Timeless Decision Theory», 2010). Его последними научными публикациями являются две статьи в сборнике «Риски глобальной катастрофы» (2008) под редакцией Ника Бострома, а именно «Искусственный интеллект как позитивный и негативный фактор глобального риска» и «Когнитивные искажения в оценке глобальных рисков». Юдковский не обучался в ВУЗах и является автодидактом без формального образования в области ИИ.Юдковский исследует те конструкции ИИ, которые способны к самопониманию, самомодификации и рекурсивному самоулучшению (Seed AI), а также такие архитектуры ИИ, которые будут обладать стабильной и позитивной структурой мотивации (Дружественный искусственный интеллект). Помимо исследовательской работы, Юдковский известен своими объяснениями сложных моделей на неакадемическом языке, доступном широкому кругу читателей, например, см. его статью «Интуитивное объяснение теоремы Байеса» «An Intuitive Explanation of Bayes' Theorem».Юдковский был вместе с Робином Хансоном одним из главных авторов блога Overcoming Bias (преодоление предубеждений). В начале 2009 года он участвовал в организации блога Less Wrong, нацеленного на «развитие рациональности человека и преодолению когнитивных искажений». После этого Overcoming Bias стал личным блогом Хансона. Материал, представленный на этих блогах, был организован в виде цепочек постов, которые смогли привлечь тысячи читателей — см. например, цепочку «теория развлечений».Он автор нескольких научно-фантастических рассказов, в которых он иллюстрирует некоторые темы, связанные с когнитивной наукой и рациональностью. В неакадемических кругах больше известен как автор фанфика «Гарри Поттер и методы рационального мышления» (англ. Harry Potter and the Methods of Rationality) под псевдонимом Less Wrong.Юдковский — один из ведущих западных трансгуманистов. Он смог привлечь внимание тысяч читателей своими принципиально новыми идеями. В частности, это его статьи о когнитивных искажениях в оценке глобальных рисков, которые открыли новый подход к этой проблеме. Многие ожидают, что Юдковский в своём институте сможет создать тот ИИ, который и приведёт человечество к позитивной сингулярности. Юдковский принадлежит идея о 5 уровнях шока будущего. Кроме того, он поставил эксперимент с ИИ в чёрном ящике (AI box experiment), в котором показал, что ИИ может уговорить человека выпустить этот ИИ из чёрного ящика, используя только текстовый канал коммуникации.

На нашем книжном сайте Вы можете скачать книги автора Элиезер Юдковский в самых разных форматах (epub, fb2, pdf, txt и многие другие). А так же читать книги онлайн и бесплатно на любом устройстве – iPad, iPhone, планшете под управлением Android, на любой специализированной читалке. Электронная библиотека КнигоГид предлагает литературу Элиезер Юдковский в жанрах .

Творчество Элиезер Юдковский

На нашем сайте представлена 21 книга автора Элиезер Юдковский. Самая популярная по мнению наших читателей "".

Это история невозможного будущего, в котором нет ни искусственного интеллекта, ни молекулярных нанотехнологий, и лишь немного биотехнологии, — но человечество каким-то образом выжило, и более того, открыло способ Перемещаться Быстрее Света. История бывшего будущего.

«Рациональность: от ИИ до зомби» (англ. Rationality: From AI to Zombies) — книга-сборник из 333 эссе о человеческой рациональности. Стоит начать с этой книги, если хотите разобраться в темах, которые часто обсуждают в сообществе LessWrong. Вы прочтете о когнитивных искажениях, соотношении «карты» и «территории», обществе и языке, о рисках искусственного интеллекта, о науке и её философии.

Из этой цепочки вы узнаете о том, как рациональное мышление соотносится с убеждениями. О том, зачем нужны объяснения и какие они бывают. О том, какое отношение рациональное мышление имеет к научному познанию и научным теориям. И немного о том, как в похожих ситуациях будут вести себя рационалисты и люди, не знакомые с рациональным мышлением.

What does it actually mean to be rational? Not Hollywood-style "rational," where you forsake all human feeling to embrace Cold Hard Logic. Real rationality, of the sort studied by psychologists, social scientists, and mathematicians. The kind of rationality where you make good decisions, even when it's hard; where you reason well, even in the face of massive uncertainty; where you recognize and ma...

Похожие авторы

Если у Вас возникли вопросы по работе сайта - напишите нам!

нашли ошибку на странице!

Нейросеть ориентируется на оценки прочитанных вами книг

поиск

Найдите книгу, автора, подборку, издательство, жанр, настроение или друга на Книгогид

подборки

Создавайте подборки с книгами, которые вы прочитали, подписывайтесь на подборки интересных пользователей.

Регистрируясь, вы соглашаетесь с нашими Условиями и политикой конфиденциальности

Книгогид использует cookie-файлы для того, чтобы сделать вашу работу с сайтом ещё более комфортной. Если Вы продолжаете пользоваться нашим сайтом, вы соглашаетесь на применение файлов cookie.